Transformer 很胜利,更个别而言,咱们乃至能够将(仅编码器)Transformer 视为进修可交流数据的通用引擎。因为年夜少数经典的统计学义务都是基于自力同散布(iid)采取假设构建的,因而很天然能够实验将 Transformer 用于它们。针对经典统计成绩练习 Transformer 的利益有两个:能够失掉更好的估量器;能够在一个有比 NLP 愈加轻易跟更好懂得的统计构造的范畴中阐释 Transformer 的任务机制。克日,MIT 的三位研讨者 Anzo Teh、Mark Jabbour 跟 Yury Polyanskiy 声称找到了一个能够满意这种需要 「可能存在的最简略的这类统计义务」,即 empirical Bayes (EB) mean estimation(教训贝叶斯均值估量)。小编:Transformer 很胜利,更个别而言,咱们乃至能够将(仅编码器)Transformer 视为学

论文题目:Solving Empirical Bayes vibet356体育官方网站a Transformers论文地点:https://arxiv.org/pdf/2502.09844该团队表现:「咱们以为 Transformer 实用于 EB,由于 EB 估量器会天然表示出压缩效应(即让均值估量倾向先验的近来形式),而 Transformer 也是如斯,留神力机制会偏向于存眷聚类 token。」对留神力机制的相干研讨可参阅论文《The emergence of clusters in self-attention dynamics》。别的,该团队还发明,EB 均值估量成绩存在置换稳定性,无需地位编码。另一方面,人们十分永利官网登录入口须要这一成绩的估量器,但费事的是最好的经典估量器(非参数最年夜似然 / NPMLE)也存在收敛速率迟缓的成绩。MIT 这个三人团队的研讨标明 Transform欧洲杯买球网er 不只机能表示赛过 NPMLE,同时还能以其近 100 倍的速率运转!总之,本文证实了即便对经典的统计成绩,Transformer 也供给了一种优良的替换计划(在运转时光跟机能方面)。对简略的 1D 泊松 - EB 义务,本文还发明,即便是参数范围十分小的 Transformer( 10 万参数)也能表示杰出。界说 EB 义务泊松 - EB 义务:经由过程一个两步式进程以自力同散布(iid)方法天生 n 个样本 X_1, . . . , X_n.第一步,从某个位于实数域 ℝ 的未知先验 π 采样 θ_1, . . . , θ_n。这里的 π 的感化是作为一个不曾见过的(非参数)隐变量,而且对其不做任何假设(设置不持续性跟腻滑性假设)。第二步,给定 θ_i,经由过程 X_i ∼ Poi (θ_i) 以 iid 方法有前提地对 X_i 停止采样。这里的目的是依据看到的 X_1, . . . , X_n,经由过程

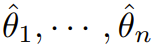

论文题目:Solving Empirical Bayes vibet356体育官方网站a Transformers论文地点:https://arxiv.org/pdf/2502.09844该团队表现:「咱们以为 Transformer 实用于 EB,由于 EB 估量器会天然表示出压缩效应(即让均值估量倾向先验的近来形式),而 Transformer 也是如斯,留神力机制会偏向于存眷聚类 token。」对留神力机制的相干研讨可参阅论文《The emergence of clusters in self-attention dynamics》。别的,该团队还发明,EB 均值估量成绩存在置换稳定性,无需地位编码。另一方面,人们十分永利官网登录入口须要这一成绩的估量器,但费事的是最好的经典估量器(非参数最年夜似然 / NPMLE)也存在收敛速率迟缓的成绩。MIT 这个三人团队的研讨标明 Transform欧洲杯买球网er 不只机能表示赛过 NPMLE,同时还能以其近 100 倍的速率运转!总之,本文证实了即便对经典的统计成绩,Transformer 也供给了一种优良的替换计划(在运转时光跟机能方面)。对简略的 1D 泊松 - EB 义务,本文还发明,即便是参数范围十分小的 Transformer( 10 万参数)也能表示杰出。界说 EB 义务泊松 - EB 义务:经由过程一个两步式进程以自力同散布(iid)方法天生 n 个样本 X_1, . . . , X_n.第一步,从某个位于实数域 ℝ 的未知先验 π 采样 θ_1, . . . , θ_n。这里的 π 的感化是作为一个不曾见过的(非参数)隐变量,而且对其不做任何假设(设置不持续性跟腻滑性假设)。第二步,给定 θ_i,经由过程 X_i ∼ Poi (θ_i) 以 iid 方法有前提地对 X_i 停止采样。这里的目的是依据看到的 X_1, . . . , X_n,经由过程 估量 θ_1, . . . , θ_n,以最小化冀望的均方偏差(MSE)

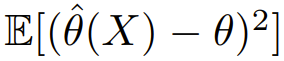

估量 θ_1, . . . , θ_n,以最小化冀望的均方偏差(MSE) 。假如 π 是已知的,则这个最小化该 MSE 的贝叶斯估量器就是 θ 的后验均值,其情势如下:

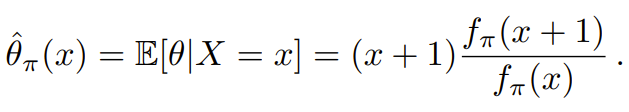

。假如 π 是已知的,则这个最小化该 MSE 的贝叶斯估量器就是 θ 的后验均值,其情势如下: 此中

此中

当前网址:https://www.unwindsessions.com//a/keji/490.html